Údery byly zaměřeny na jaderná zařízení ve Fordow, Natanzu a Isfahánu, uvedl Trump na sociální síti.

Entropie

Z Multimediaexpo.cz

(+ Výrazné vylepšení) |

m (Nahrazení textu „</math>“ textem „\)</big>“) |

||

| (Nejsou zobrazeny 3 mezilehlé verze.) | |||

| Řádka 1: | Řádka 1: | ||

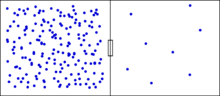

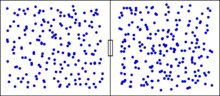

| - | + | [[Soubor:SmallEntropy.png|thumb|220px|Termodynamický systém s nízkou entropií - "zúženým" rozložením pravděpodobnosti, a tedy "vysokou" schopností konat práci.]] | |

| + | [[Soubor:HighEntropy.png|thumb|220px|Termodynamický systém s vysokou entropií - "rozšířeným" rozložením pravděpodobnosti, a tedy nízkou schopností konat práci.]] | ||

| + | '''Entropie''' je jedním ze základních a nejdůležitějších pojmů ve [[fyzika|fyzice]], [[teorie pravděpodobnosti|teorii pravděpodobnosti]] a [[teorie informace|teorii informace]], [[matematika|matematice]] a mnoha dalších oblastech vědy teoretické i aplikované. Setkáváme se s ní všude tam, kde hovoříme o pravděpodobnosti možných stavů daného systému či soustavy. | ||

| + | V populárních výkladech se často vyskytuje přiblížení entropie jako veličiny udávající "míru neuspořádanosti" zkoumaného systému. Není to dobré vysvětlení, neboť tato "definice" používá pojem "neuspořádanost", který je však sám nedefinovaný. Vhodnější je intuitivní představa entropie jako míry neurčitosti systému. Zatímco "ostrá" rozdělení pravděpodobnosti (jako např. [[prahování]]) mají entropii nízkou, naopak "neostrá" či "rozmazaná" rozdělení pravděpodobnosti mají entropii vysokou. Za pravděpodobnostní rozložení s nejvyšší entropií lze považovat [[normální rozdělení|normální]] (pro danou střední hodnotu a směrodatnou odchylku) nebo [[rovnoměrné rozdělení|rovnoměrné]] (pro daný interval) rozložení. | ||

| + | |||

| + | Původ slova "entropie" je odvozen z [[Řečtina|řeckého]] ''εντροπία'', "směrem k", (''εν-'' "k" + ''τροπή'' "směrem").<ref>{{Citace elektronické monografie| url=http://www.etymonline.com/index.php?term=entropy| titul=Entropy| vydavatel= Online Etymology Dictionary | datum přístupu=2008-08-05}}</ref> | ||

| + | |||

| + | == Historie == | ||

| + | Pojem (termodynamické) entropie zavedl [[Rudolf Clausius]] v kontextu [[klasická termodynamika|klasické termodynamiky]] s cílem vysvětlit, proč některé procesy jsou spontánní a jiné nejsou. | ||

| + | |||

| + | Mikroskopickou definici entropie předložil Ludwig Boltzmann v roce 1887, jako jeden z centrálních pojmů jím založeného nového oboru fyziky - [[statistická fyzika|statistické mechaniky]]. | ||

| + | |||

| + | ==Definice== | ||

| + | V případě diskrétních stavů i pravděpodobností je entropie nejčastěji definovaná ([[Josiah Willard Gibbs]]) jako veličina typu: | ||

| + | :<big> | ||

| + | kde ''S'' je obecně používaný symbol pro entropii. Sumace se provádí přes všechny [[mikrostav]]y, odpovídající zadanému [[makrostav]]u, a <big> | ||

| + | :<big> | ||

| + | Z matematického pohledu je tedy entropie určitý aditivní [[funkcionál]] na [[Rozdělení pravděpodobnosti|pravděpodobnostních rozděleních]]. Z pohledu fyziky je entropie klíčová veličina pro formulaci [[druhý zákon termodynamiky|druhého zákona termodynamiky]]. Tento zákon klade principiální meze pro možnost získat z termodynamické soustavy [[práce (termodynamika)|užitečnou práci]].<ref name="Daintith">{{Citace monografie| příjmení = Daintith | jméno = John | titul = Oxford Dictionary of Physics | vydavatel = Oxford University Press | rok = 2005 | isbn = 0-19-280628-9}}</ref><ref>Explicitněji řečeno, energie ''T<sub>R</sub>S'' je coby užitečná práce nedostupná, přičemž ''T<sub>R</sub>'' je teplota nejchladnějšího vnějšího rezervoáru tepla. </ref> Pojem entropie a druhý zákon termodynamiky může být také uplatněn k řešení otázky, jestli daný proces bude probíhat spontánně. [[Spontánní proces]]y v [[uzavřená soustava|uzavřených soustavách]] vždy odpovídají vzrůstu entropie. | ||

| + | |||

| + | V případě izolovaného systému v rovnováze (Boltzmann) platí: | ||

| + | : <big> | ||

| + | kde <big> | ||

| + | |||

| + | == Termodynamická entropie == | ||

| + | Termodynamickou entropii lze vyjádřit pomocí tepla <big> | ||

| + | :<big> | ||

| + | Podíl tepla <big> | ||

| + | |||

| + | Proběhnutí všech elementárních Carnotových cyklů je pak ekvivalentní aproximovanému vratnému ději, což lze vyjádřit jako | ||

| + | :<big> | ||

| + | Postupným zmenšováním elementárních Carnotových cyklů se v [[limita|limitě]] dostaneme k výrazu | ||

| + | :<big> | ||

| + | Tento vztah je označován jako '''Clausiova rovnice''' a představuje podmínku, která je platná pro libovolný [[vratný proces|vratný]] [[kruhový děj]]. Tuto rovnici lze považovat za matematické vyjádření [[Druhý zákon termodynamiky|druhé hlavní věty termodynamiky]]. | ||

| + | |||

| + | Z předchozího vztahu je vidět, že všechna <big> | ||

| + | |||

| + | == Princip růstu entropie == | ||

| + | Entropie je veličina s velkým významem, neboť umožňuje formulovat druhou hlavní větu termodynamiky, a vyjádřit kvantitativně nevratnost tepelných pochodů. Tuto skutečnost vyjadřuje '''princip růstu entropie'''. | ||

| + | |||

| + | Za příklad [[nevratný děj|nevratného děje]] můžeme považovat pokles [[břemeno|závaží]] spojený s uvolněním jisté [[potenciální energie]]. Pokud klesne závaží o určitou [[výška|výšku]] <big> | ||

| + | |||

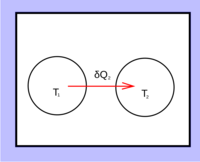

| + | [[File:Entropie princip rustu.png|thumb|200px|Tepelně izolovaná soustava]] | ||

| + | Uvažujme tepelně izolovanou soustavu dvou [[těleso|těles]] ''1'' a ''2'' s teplotami <big> | ||

| + | |||

| + | Tělesa si mohou vyměňovat [[tepelná energie|tepelnou energii]], přičemž celková hodnota tepelné energie zůstává [[konstanta|stálá]]. Získá-li těleso ''2'' o teplotě <big> | ||

| + | |||

| + | Změna entropie bude | ||

| + | :<big> | ||

| + | Z tohoto vztahu je vidět, že pokud mají výraz <big> | ||

| + | :<big> | ||

| + | |||

| + | Celková entropie izolované soustavy dvou těles různých teplot tedy roste. Jsou-li teploty dosti blízké, nebo jsou-li tělesa od sebe dostatečně dobře izolována, může být změna entropie libovolně malá. V takové soustavě prakticky nedochází k výměně tepla a soustava je blízká [[tepelná rovnováha|tepelné rovnováze]]. Děje, které probíhají v takové soustavě, lze považovat za [[vratný děj|vratné]], a jejich entropie se téměř nemění. Při vratném [[adiabatický děj|adiabatickém ději]] může být tedy entropie stálá, avšak nikdy nemůže klesat. | ||

| + | |||

| + | V tepelně izolované soustavě probíhají děje adiabatické. V každé soustavě mohou z počátečního stavu vzniknout různé stavy vratnou nebo nevratnou změnou. Stavy, kterých soustava dosáhne nevratnou změnou, se podle druhé termodynamické věty liší od stavů při vratné změně tím, že z nich soustava sama od sebe bez vnějšího zásahu nemůže přejít zpět do výchozího stavu. Mimoto jsou zde stavy, z nichž lze počátečního stavu soustavy dosáhnout nevratnou změnou. Tyto stavy však soustava nemůže z počátečního stavu dosáhnout bez vnějšího zásahu. Odsud plyne další možné vyjádření [[druhá věta termodynamická|druhé hlavní věty termodynamiky]]: ''V blízkosti každého [[stav tělesa|stavu soustavy]] existují stavy, kterých nelze dosáhnout adiabatickým dějem''. Takové stavy jsou tedy v izolované soustavě vyloučeny. | ||

| + | |||

| + | Podle [[Carnotova věta|Carnotovy věty]] je účinnost nevratného kruhového děje mezi teplotami <big> | ||

| + | :<big> | ||

| + | Vydané teplo <big> | ||

| + | :<big> | ||

| + | |||

| + | Pokud děj neprobíhá pouze mezi dvěma teplotami, ale při spojitě se měnících teplotách, přejde předchozí [[součet]] v [[limita|limitě]] na [[integrál]] po uzavřené cestě | ||

| + | :<big> | ||

| + | Tento vztah se obvykle zapisuje ve tvaru | ||

| + | :<big> | ||

| + | kde znaménko rovnosti platí pro vratný kruhový děj. Jde vlastně o vyjádření skutečnosti, že při libovolném kruhovém ději, při němž se teplo mění v [[mechanická energie|mechanickou energii]], nemohou být všechna <big> | ||

| + | |||

| + | Pokud se entropie procesu zvyšuje, je tento [[nevratný proces|proces nevratný]] ([[ireverzibilita|ireverzibilní]]). Pokud zůstává [[konstanta|konstantní]], je tento [[vratný proces|proces vratný]] ([[reverzibilita|reverzibilní]]), jako např. u ideálního [[Carnotův kruhový děj|Carnotova kruhového děje]]. | ||

| + | |||

| + | Celková entropie uzavřeného systému se nemůže nikdy zmenšit. V přírodě tedy všechny děje směřují do více neuspořádaného stavu. Stejně tak roste entropie ve [[vesmír]]u. Dle předpokladů L. Boltzmana se jeví jako [[pravděpodobnost|nejpravděpodobnější]] konečný stav vyrovnání pohybových energií molekul. To znamená, že by se konečné hodnoty entropie ve vesmíru dosáhlo tehdy, kdyby se vyrovnaly veškeré teplotní rozdíly ([[tepelná smrt]]). | ||

| + | |||

| + | == Informační entropie == | ||

| + | '''Informační entropie''' velmi úzce souvisí s termodynamickou entropií, ačkoliv toto spojení se ukázalo být zřejmé až po mnoha letech nezávislého studia termodynamické entropie a informační entropie. Často je také nazývána ''Shannonovou entropií'' po [[Claude Elwood Shannon|Claude E. Shannonovi]], který zformuloval mnoho klíčových poznatků [[Teoretická informatika|teoretické informatiky]]. | ||

| + | Obecně pro systém s konečným počtem možných stavů <big> | ||

| + | :<big> | ||

| + | Zde formálně definujeme, že <big> | ||

| + | |||

| + | Entropie je ''maximální'' pro rovnoměrné rozložení <big> | ||

| + | :<big> | ||

| + | a ''minimální'' pro zcela deterministický systém <big> | ||

| + | :<big> | ||

| + | |||

| + | Stručně řečeno, entropie je střední hodnota informace jednoho kódovaného znaku. Míra entropie souvisí s problematikou generování [[Náhodná sekvence|sekvence náhodných čísel]] (resp. [[Pseudonáhodné číslo|pseudonáhodných]] čísel), protože sekvence naprosto náhodných čísel by měla mít maximální míru entropie. Shannonova entropie také tvoří limit při [[Bezeztrátová komprese|bezeztrátové kompresi]] dat, laicky řečeno, komprimovaná data nelze beze ztráty informace „zhustit“ více, než dovoluje jejich entropie. | ||

| + | |||

| + | Jako jistou míru vzdálenosti mezi dvěma [[rozdělení pravděpodobnosti|rozděleními pravděpodobnosti]] lze definovat '''relativní entropii'''<ref>Vajda I., ''Teorie informace''. Vydavatelství ČVUT, Praha 2004. ISBN 80-01-02986-7</ref> a to následovně: nechť ''p = p(x)'' a ''q = q(x)'' jsou dvě rozdělení pravděpodobnosti na množině <big> | ||

| + | :<big> | ||

| + | |||

| + | === Odvození entropie === | ||

| + | Podobně jako ve fyzice lze vztah pro entropii odvodit kombinatoricky s použitím Stirlingova vzorce (na levé straně vzorečku je počet možných textů nad nějakou abecedou vzhledem k nějakému diskrétnímu pravděpodobnostnímu rozdělení):<ref>http://www.billix.eu/entropy.html Multinomiální odvození entropie</ref> | ||

| + | |||

| + | <big> | ||

| + | |||

| + | kde <big> | ||

| + | |||

| + | |||

| + | == Reference == | ||

| + | <references /> | ||

| + | == Externí odkazy == | ||

| + | * {{MathWorld| id=Entropy}} | ||

| + | * {{Citace elektronického periodika | příjmení = Skácel| jméno = Dalibor | titul = Co to je entropie? | periodikum = Alternativní energie | datum vydání = 2002-03-21 | url = http://www.tzb-info.cz/925-co-to-je-entropie }} | ||

| + | |||

| + | |||

| + | {{Článek z Wikipedie}} | ||

[[Kategorie:Termodynamika]] | [[Kategorie:Termodynamika]] | ||

[[Kategorie:Statistická mechanika]] | [[Kategorie:Statistická mechanika]] | ||

[[Kategorie:Informatika]] | [[Kategorie:Informatika]] | ||

| + | [[Kategorie:Teorie informace]] | ||

Aktuální verze z 14. 8. 2022, 14:51

Entropie je jedním ze základních a nejdůležitějších pojmů ve fyzice, teorii pravděpodobnosti a teorii informace, matematice a mnoha dalších oblastech vědy teoretické i aplikované. Setkáváme se s ní všude tam, kde hovoříme o pravděpodobnosti možných stavů daného systému či soustavy.

V populárních výkladech se často vyskytuje přiblížení entropie jako veličiny udávající "míru neuspořádanosti" zkoumaného systému. Není to dobré vysvětlení, neboť tato "definice" používá pojem "neuspořádanost", který je však sám nedefinovaný. Vhodnější je intuitivní představa entropie jako míry neurčitosti systému. Zatímco "ostrá" rozdělení pravděpodobnosti (jako např. prahování) mají entropii nízkou, naopak "neostrá" či "rozmazaná" rozdělení pravděpodobnosti mají entropii vysokou. Za pravděpodobnostní rozložení s nejvyšší entropií lze považovat normální (pro danou střední hodnotu a směrodatnou odchylku) nebo rovnoměrné (pro daný interval) rozložení.

Původ slova "entropie" je odvozen z řeckého εντροπία, "směrem k", (εν- "k" + τροπή "směrem").[1]

Obsah[skrýt] |

Historie

Pojem (termodynamické) entropie zavedl Rudolf Clausius v kontextu klasické termodynamiky s cílem vysvětlit, proč některé procesy jsou spontánní a jiné nejsou.

Mikroskopickou definici entropie předložil Ludwig Boltzmann v roce 1887, jako jeden z centrálních pojmů jím založeného nového oboru fyziky - statistické mechaniky.

Definice

V případě diskrétních stavů i pravděpodobností je entropie nejčastěji definovaná (Josiah Willard Gibbs) jako veličina typu:

kde S je obecně používaný symbol pro entropii. Sumace se provádí přes všechny mikrostavy, odpovídající zadanému makrostavu, a

Z matematického pohledu je tedy entropie určitý aditivní funkcionál na pravděpodobnostních rozděleních. Z pohledu fyziky je entropie klíčová veličina pro formulaci druhého zákona termodynamiky. Tento zákon klade principiální meze pro možnost získat z termodynamické soustavy užitečnou práci.[2][3] Pojem entropie a druhý zákon termodynamiky může být také uplatněn k řešení otázky, jestli daný proces bude probíhat spontánně. Spontánní procesy v uzavřených soustavách vždy odpovídají vzrůstu entropie.

V případě izolovaného systému v rovnováze (Boltzmann) platí:

kde

Termodynamická entropie

Termodynamickou entropii lze vyjádřit pomocí tepla

Podíl tepla

Proběhnutí všech elementárních Carnotových cyklů je pak ekvivalentní aproximovanému vratnému ději, což lze vyjádřit jako

Postupným zmenšováním elementárních Carnotových cyklů se v limitě dostaneme k výrazu

Tento vztah je označován jako Clausiova rovnice a představuje podmínku, která je platná pro libovolný vratný kruhový děj. Tuto rovnici lze považovat za matematické vyjádření druhé hlavní věty termodynamiky.

Z předchozího vztahu je vidět, že všechna

Princip růstu entropie

Entropie je veličina s velkým významem, neboť umožňuje formulovat druhou hlavní větu termodynamiky, a vyjádřit kvantitativně nevratnost tepelných pochodů. Tuto skutečnost vyjadřuje princip růstu entropie.

Za příklad nevratného děje můžeme považovat pokles závaží spojený s uvolněním jisté potenciální energie. Pokud klesne závaží o určitou výšku

Uvažujme tepelně izolovanou soustavu dvou těles 1 a 2 s teplotami

Tělesa si mohou vyměňovat tepelnou energii, přičemž celková hodnota tepelné energie zůstává stálá. Získá-li těleso 2 o teplotě

Změna entropie bude

Z tohoto vztahu je vidět, že pokud mají výraz

Celková entropie izolované soustavy dvou těles různých teplot tedy roste. Jsou-li teploty dosti blízké, nebo jsou-li tělesa od sebe dostatečně dobře izolována, může být změna entropie libovolně malá. V takové soustavě prakticky nedochází k výměně tepla a soustava je blízká tepelné rovnováze. Děje, které probíhají v takové soustavě, lze považovat za vratné, a jejich entropie se téměř nemění. Při vratném adiabatickém ději může být tedy entropie stálá, avšak nikdy nemůže klesat.

V tepelně izolované soustavě probíhají děje adiabatické. V každé soustavě mohou z počátečního stavu vzniknout různé stavy vratnou nebo nevratnou změnou. Stavy, kterých soustava dosáhne nevratnou změnou, se podle druhé termodynamické věty liší od stavů při vratné změně tím, že z nich soustava sama od sebe bez vnějšího zásahu nemůže přejít zpět do výchozího stavu. Mimoto jsou zde stavy, z nichž lze počátečního stavu soustavy dosáhnout nevratnou změnou. Tyto stavy však soustava nemůže z počátečního stavu dosáhnout bez vnějšího zásahu. Odsud plyne další možné vyjádření druhé hlavní věty termodynamiky: V blízkosti každého stavu soustavy existují stavy, kterých nelze dosáhnout adiabatickým dějem. Takové stavy jsou tedy v izolované soustavě vyloučeny.

Podle Carnotovy věty je účinnost nevratného kruhového děje mezi teplotami

Vydané teplo

Pokud děj neprobíhá pouze mezi dvěma teplotami, ale při spojitě se měnících teplotách, přejde předchozí součet v limitě na integrál po uzavřené cestě

Tento vztah se obvykle zapisuje ve tvaru

kde znaménko rovnosti platí pro vratný kruhový děj. Jde vlastně o vyjádření skutečnosti, že při libovolném kruhovém ději, při němž se teplo mění v mechanickou energii, nemohou být všechna

Pokud se entropie procesu zvyšuje, je tento proces nevratný (ireverzibilní). Pokud zůstává konstantní, je tento proces vratný (reverzibilní), jako např. u ideálního Carnotova kruhového děje.

Celková entropie uzavřeného systému se nemůže nikdy zmenšit. V přírodě tedy všechny děje směřují do více neuspořádaného stavu. Stejně tak roste entropie ve vesmíru. Dle předpokladů L. Boltzmana se jeví jako nejpravděpodobnější konečný stav vyrovnání pohybových energií molekul. To znamená, že by se konečné hodnoty entropie ve vesmíru dosáhlo tehdy, kdyby se vyrovnaly veškeré teplotní rozdíly (tepelná smrt).

Informační entropie

Informační entropie velmi úzce souvisí s termodynamickou entropií, ačkoliv toto spojení se ukázalo být zřejmé až po mnoha letech nezávislého studia termodynamické entropie a informační entropie. Často je také nazývána Shannonovou entropií po Claude E. Shannonovi, který zformuloval mnoho klíčových poznatků teoretické informatiky.

Obecně pro systém s konečným počtem možných stavů

Zde formálně definujeme, že

Entropie je maximální pro rovnoměrné rozložení

a minimální pro zcela deterministický systém

Stručně řečeno, entropie je střední hodnota informace jednoho kódovaného znaku. Míra entropie souvisí s problematikou generování sekvence náhodných čísel (resp. pseudonáhodných čísel), protože sekvence naprosto náhodných čísel by měla mít maximální míru entropie. Shannonova entropie také tvoří limit při bezeztrátové kompresi dat, laicky řečeno, komprimovaná data nelze beze ztráty informace „zhustit“ více, než dovoluje jejich entropie.

Jako jistou míru vzdálenosti mezi dvěma rozděleními pravděpodobnosti lze definovat relativní entropii[4] a to následovně: nechť p = p(x) a q = q(x) jsou dvě rozdělení pravděpodobnosti na množině

Odvození entropie

Podobně jako ve fyzice lze vztah pro entropii odvodit kombinatoricky s použitím Stirlingova vzorce (na levé straně vzorečku je počet možných textů nad nějakou abecedou vzhledem k nějakému diskrétnímu pravděpodobnostnímu rozdělení):[5]

kde

Reference

- ↑ Entropy [online]. Online Etymology Dictionary, [cit. 2008-08-05]. Dostupné online.

- ↑ DAINTITH, John. Oxford Dictionary of Physics. [s.l.] : Oxford University Press, 2005. ISBN 0-19-280628-9.

- ↑ Explicitněji řečeno, energie TRS je coby užitečná práce nedostupná, přičemž TR je teplota nejchladnějšího vnějšího rezervoáru tepla.

- ↑ Vajda I., Teorie informace. Vydavatelství ČVUT, Praha 2004. ISBN 80-01-02986-7

- ↑ http://www.billix.eu/entropy.html Multinomiální odvození entropie

Externí odkazy

- Entropie v encyklopedii MathWorld (anglicky)

- SKÁCEL, Dalibor. Co to je entropie?. Alternativní energie [online]. 2002-03-21. Dostupné online.

| [zobrazit] Náklady na energie a provoz naší encyklopedie prudce vzrostly. Potřebujeme vaši podporu... Kolik ?? To je na Vás. Náš FIO účet — 2500575897 / 2010 |

|---|